Kelimeler… İnsanlığın inşa ettiği en karmaşık, en görkemli icat. Bazen bir devrimi başlatır, bazen insanın içindeki o derin yalnızlığı, tutunamama hissini en çarpıcı şekilde tarif eder. Peki, ruhu olmayan silikon çipler ve soğuk sunucular, bu kelimelerin ardındaki anlamı, mantığı ve hatta o ince hüznü nasıl kavramaya başladı?

Bugün AltF4Yapın’da ekranın arkasındaki o büyülü dünyaya, karmaşık teknolojik kavramların en sade haline iniyoruz. Sadece komutlara itaat eden makinelerden; kendi hikayesini yazan, kod üreten ve tasarım yapan sistemlere geçişimizi sağlayan o büyük sıçramayı konuşacağız. Karşınızda tüm şeffaflığıyla üretken yapay zeka nasıl çalışır sorusunun cevabı ve geleceği inşa eden mimariler.

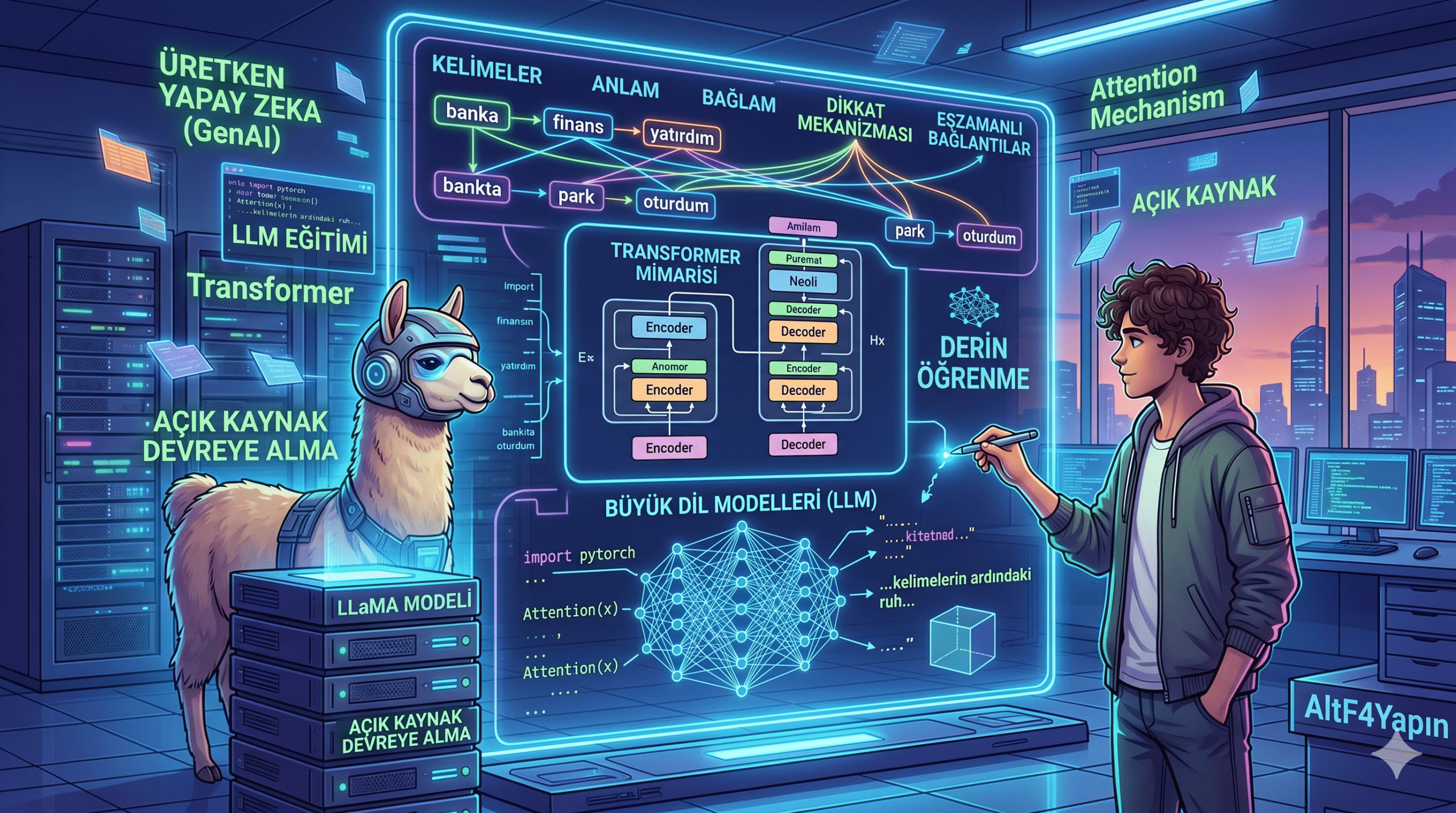

Büyük Dil Modelleri (LLM) Eğitimi: Kelimelerin Matematiği

Geleneksel yapay zeka (Geleneksel AI), elindeki verileri sınıflandırmak ve analiz etmek üzerine kuruluydu (Örneğin; “Bu fotoğraftaki bir araba mı, yoksa bisiklet mi?”). Ancak Üretken Yapay Zeka (GenAI), mevcut verilerin desenlerini öğrenerek daha önce var olmayan yepyeni ve orijinal içerikler üretir.

Bunun kalbinde Büyük Dil Modelleri (Large Language Models) yatar. Büyük dil modelleri (LLM) eğitimi, aslında çok gelişmiş ve devasa bir olasılık oyunudur. Siz yapay zekaya bir soru sorduğunuzda, sistem kelimeleri bir insan gibi “düşünmez”. Milyarlarca parametre ve terabaytlarca veri arasından, bir önceki kelimeye bakarak en mantıklı sıradaki kelimeyi tahmin eder. Ancak bu tahmin yeteneğinin bu kadar kusursuz olmasını ve bağlamı koparmamasını sağlayan, yakın geçmişte yaşanan devrimsel bir keşiftir.

Her Şeyi Değiştiren Makale: Transformer ve Attention Mimarisi

2017 yılında araştırmacılar “Attention Is All You Need” (İhtiyacınız Olan Tek Şey Dikkat) adlı bir makale yayınladı ve yapay zeka dünyasında kartlar tamamen yeniden dağıtıldı. Bu makale, transformer ve attention mimarisi kavramlarını hayatımıza soktu.

Eski nesil modeller (RNN ve LSTM gibi), bir metni okurken kelimeleri sırayla işlerdi. Cümle veya paragraf uzadıkça, cümlenin başındaki bağlamı unuturlardı. Tıpkı kafası dağınık birinin uzun bir hikayeyi dinlerken ipin ucunu kaçırması gibi.

Attention (Dikkat) Mekanizması ise modele, bir cümledeki hangi kelimelerin birbirine daha sıkı bağlı olduğunu aynı anda görme yeteneği verdi.

- “Banka hesabıma para yatırdım, sonra yorulup parktaki bankta oturdum.” Transformer mimarisi, ilk “banka” kelimesinin finansal bir kurum, ikinci “bank” kelimesinin ise parktaki ahşap bir oturak olduğunu cümlenin bütününe dikkat ederek eşzamanlı anlar. İşlemleri sırayla değil, paralel olarak yapabilmesi, yapay zekanın metinleri bir insan gibi derinlemesine anlamlandırmasını ve çok hızlı eğitilmesini sağladı.

LLaMA Modeli ve Açık Kaynak (Open-Source) Devrimi

Kapalı kapılar ardında geliştirilen devasa ticari modellerin yanı sıra, açık kaynak dünyası da boş durmuyor. Özellikle Meta’nın piyasaya sürdüğü LLaMA modeli ve benzeri açık kaynaklı projeler, bu muazzam gücü tabana yaydı.

Bu devrim sayesinde, artık standart bir geliştirici donanımına sahip olanlar bile bu dil modellerini indirip kendi verileriyle ince ayar (fine-tuning) yapabiliyor. Kendi spesifik görevleriniz için (örneğin sadece şirketinizin belgelerini okuyan bir asistan veya sadece oyun kodları yazan bir yapay zeka) özelleştirilmiş sistemler kurmak artık hayal değil.

Artık teknoloji dünyasında mesele sadece kod yazmak değil; bu devasa dil modellerinin mantığını anlamak, onları projelerimize entegre edebilmek ve doğru yönlendirmelerle (prompt engineering) maksimum verimi alabilmektir. Karmaşık gibi görünen bu sistemlerin temelinde yatan matematiği anladığınızda, yapay zeka sizin için korkutucu bir bilinmezlik olmaktan çıkıp, en yetenekli asistanınıza dönüşecektir.